제목

"OpenAI API 키부터 발급받지 마세요. 당신의 서비스가 '비용 폭탄' 맞고 종료될 확률은 99%입니다."

본문

솔직히 고백하자면, 저도 최근까지 '클라우드 만능주의'라는 지독한 병에 걸려 있었습니다. 스타트업 시절부터 "서버는 당연히 AWS지", "AI 기능? 당연히 GPT-4 API 연동하면 끝 아니야?"라고 생각했으니까요. 얼마 전, 팀 내부에서 사용할 간단한 슬랙 봇을 만들 때도 제 손은 무의식적으로 OpenAI API 키 발급 버튼을 누르고 있었습니다. 하지만 최근 우연히 발견한 Interpreter라는 오픈소스 프로젝트를 뜯어보며, 저는 제 자신이 부끄러워 얼굴이 화끈거렸습니다. 8년 차 개발자랍시고 거들먹거렸지만, 정작 저는 '비용'과 '효율'이라는 엔지니어링의 본질을 잊고 그저 남이 만들어둔 API를 연결하는 '배관공' 노릇만 하고 있었던 겁니다.

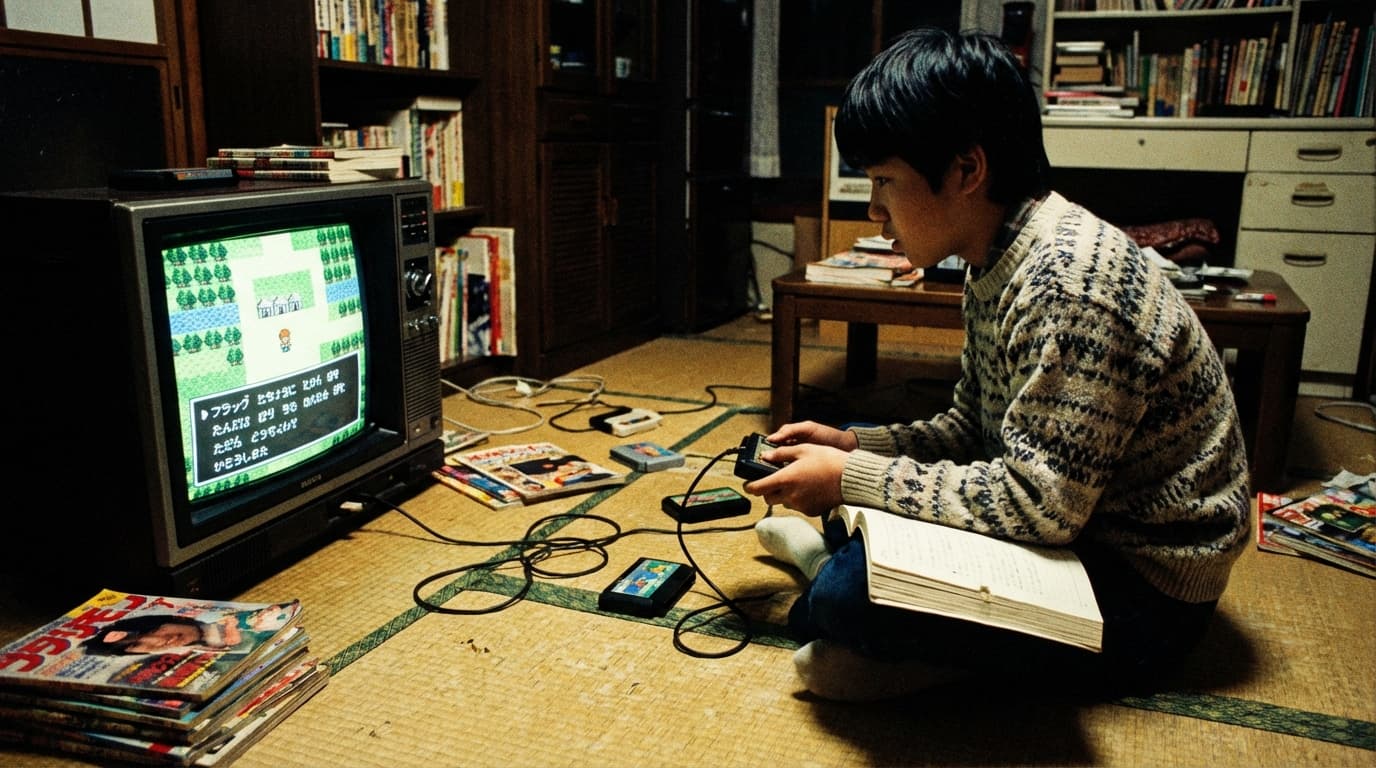

제가 충격을 받은 프로젝트는 일본 레트로 게임의 화면을 실시간으로 번역해 주는 도구였습니다. 보통 이런 기능을 구현한다고 하면, 대부분의 개발자는 구글 Vision API로 OCR을 처리하고, DeepL이나 GPT-4 API로 번역하는 아키텍처를 떠올릴 겁니다. 하지만 이 프로젝트는 정반대였습니다. 외부 API를 단 하나도 쓰지 않습니다. MeikiOCR이라는, 픽셀 폰트에 특화된 로컬 OCR 모델을 사용하고, 번역 역시 Sugoi V4라는 오프라인 모델을 로컬에서 돌립니다. 클라우드 비용 0원, 네트워크 지연 시간(Latency) 0초, 그리고 내 화면 데이터가 외부로 유출될 걱정도 없는 완벽한 '프라이빗' 솔루션입니다.

이 프로젝트가 주는 교훈은 단순히 "돈을 아꼈다"는 수준이 아닙니다. 바로 '비즈니스 도메인에 대한 집착'입니다. 범용적인 클라우드 OCR은 훌륭하지만, 8비트 게임 특유의 뭉개진 픽셀 폰트를 읽는 데는 오히려 성능이 떨어질 수 있습니다. 이 개발자는 '레트로 게임'이라는 명확한 타깃을 위해 무겁고 비싼 SOTA(State-of-the-Art) 모델 대신, 가볍고 특화된 로컬 모델을 선택했습니다. 만약 제가 이 프로젝트를 맡았다면 어땠을까요? 아마 "GPT-4가 문맥 파악을 더 잘해요"라며 비싼 API 비용을 청구했을 것이고, 게이머들은 번역 한 줄이 나올 때마다 1~2초씩 멈칫하는 게임 화면을 보며 욕을 했을 겁니다. 기술적으로 더 '우아한' 최신 기술을 썼을지 몰라도, 사용자 경험(UX) 측면에서는 처참하게 실패했을 것입니다.

저를 포함한 많은 시니어, 그리고 이제 막 커리어를 쌓아가는 주니어 개발자분들께 꼭 드리고 싶은 말씀이 있습니다. AI 시대가 도래하면서 우리는 너무 쉽게 '외부 의존성'을 늘리고 있습니다. 물론 MVP(최소 기능 제품) 단계에서 빠른 검증을 위해 API를 쓰는 건 현명한 전략입니다. 하지만 "이게 최선인가?"라는 질문을 던지지 않고 습관적으로 클라우드를 찾는 건 위험합니다. 특히 최근엔 라마(Llama)나 젬마(Gemma) 같은 고성능 경량화 모델(SLM)들이 쏟아져 나오고 있습니다. 사용자의 로컬 머신 리소스를 활용하면 비용은 제로가 되고, 서비스의 지속 가능성은 무한대가 됩니다.

저는 이번 주말, 그동안 짰던 사이드 프로젝트의 코드를 다시 열었습니다. 그리고 무의식적으로 박아두었던 API 호출 코드를 걷어내고, 로컬에서 돌아가는 경량 모델로 대체하는 작업을 시작했습니다. Interpreter 프로젝트가 보여준 것처럼, 진짜 실력은 세상에 없던 엄청난 기술을 쓰는 게 아니라, 주어진 제약 조건 안에서 사용자의 문제를 가장 '싸고 빠르고 정확하게' 해결해 주는 것임을 뼈저리게 느꼈기 때문입니다. 여러분의 프로젝트에도 혹시 불필요한 'API 통행세'가 붙어있지는 않나요? 지금 당장 그 코드를 다시 한번 들여다보시기 바랍니다.